Hugging Face(官网:https://huggingface.co)是一个专注于自然语言处理(NLP)、机器学习和人工智能的开源社区与平台,被称为 “机器学习界的 GitHub”。

全球最大的开源模型共享平台之一,包含数万种预训练模型,覆盖:

- NLP 任务:文本分类、翻译、问答、摘要、情感分析等(如 BERT、GPT、LLaMA、T5 等)。

- 多模态模型:图文生成、语音处理(如 CLIP、Whisper)。

- 框架支持:兼容 PyTorch、TensorFlow、JAX 等主流框架,可直接下载使用。

每个模型都有详细文档、使用示例和社区反馈,方便开发者快速复用。

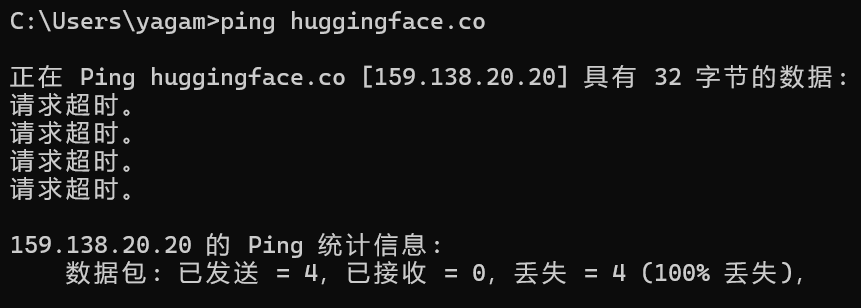

因为不知名的原因,目前国内网络无法正常访问,

如果你是AI界的新手,遇到的第一个难题就是拉取Huggingface的模型。

本文介绍最简单的方法下载Huggingface上的模型,不需要科学上网,也不需要使用付费(https://aliendao.cn/)

教程

首先pip安装Huggingface自家的模型下载库

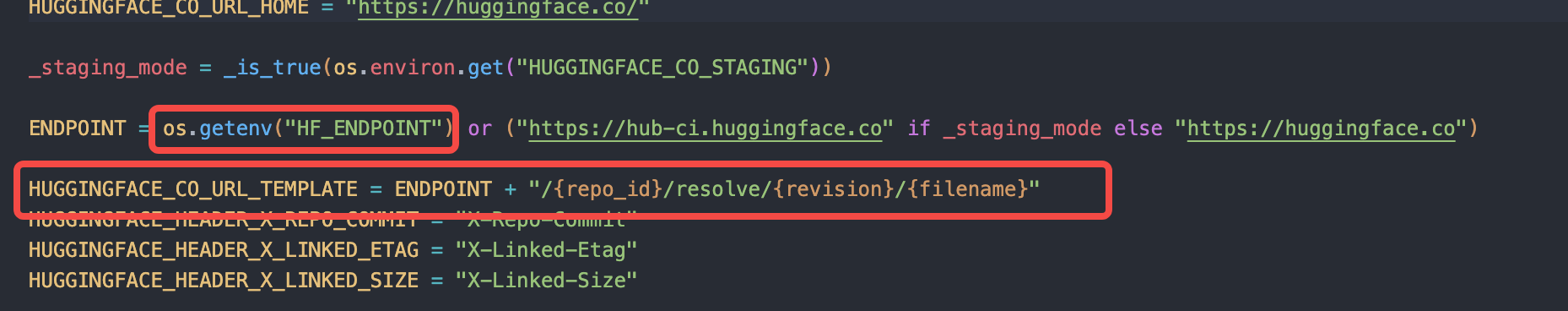

pip install huggingface-hub这个自动从HF_ENDPOINT 这个环境变量下载模型

然后我们利用国内的镜像地址:https://hf-mirror.com 即可。感谢该站点做出的共享

linux

export HF_ENDPOINT=https://hf-mirror.com windows

set HF_ENDPOINT=https://hf-mirror.com然后使用下面的代码下载你需要的模型文件:

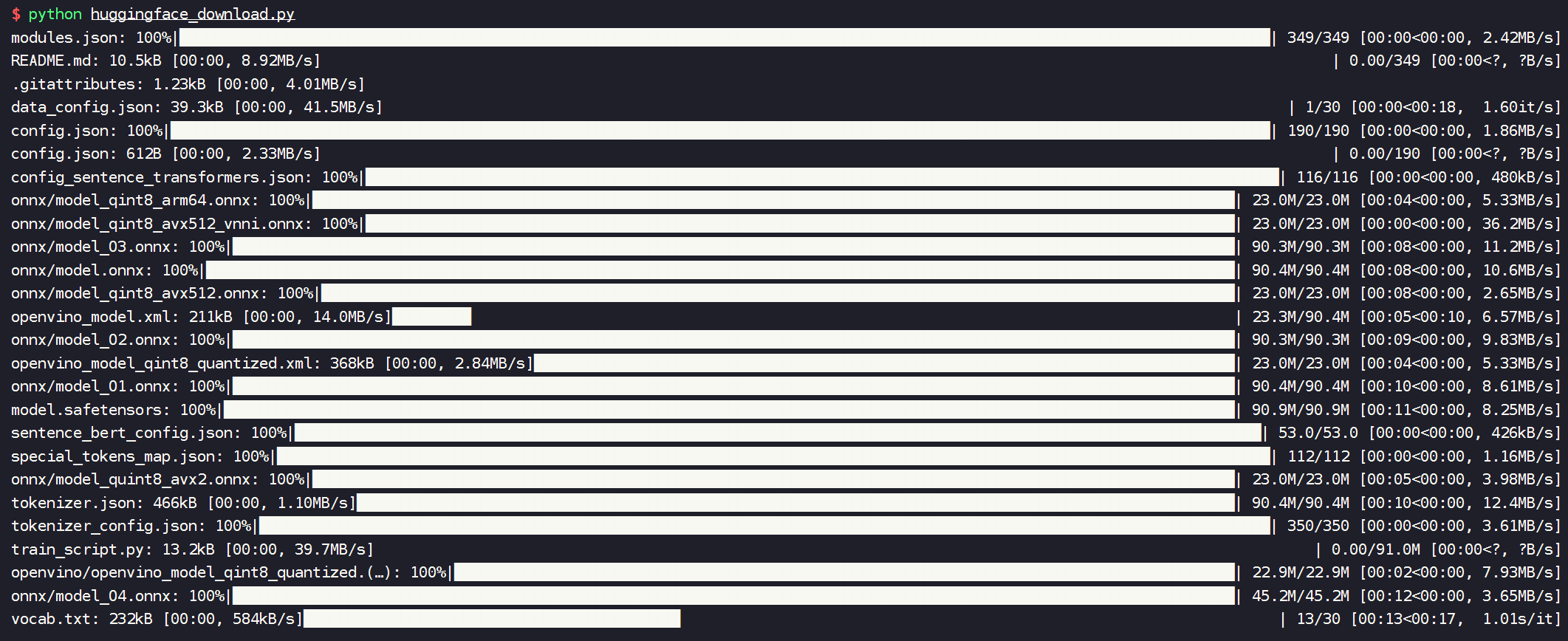

比如我们要下载sentence-transformers/all-MiniLM-L6-v2 这个模型。

只需要运行下面的python脚本即可。自定义下载的路径为./local-models/all-MiniLM-L6-v2

from huggingface_hub import snapshot_download

# 示例:下载整个模型仓库(推荐)

# 下载 "sentence-transformers/all-MiniLM-L6-v2" 完整模型到本地

model_dir = snapshot_download(

repo_id="sentence-transformers/all-MiniLM-L6-v2",

local_dir="./local-models/all-MiniLM-L6-v2" # 本地保存路径

)

print(f"模型已保存到:{model_dir}")保存为任意文件名,比如 huggingface_download.py

执行

python huggingface_download.py速度很快。

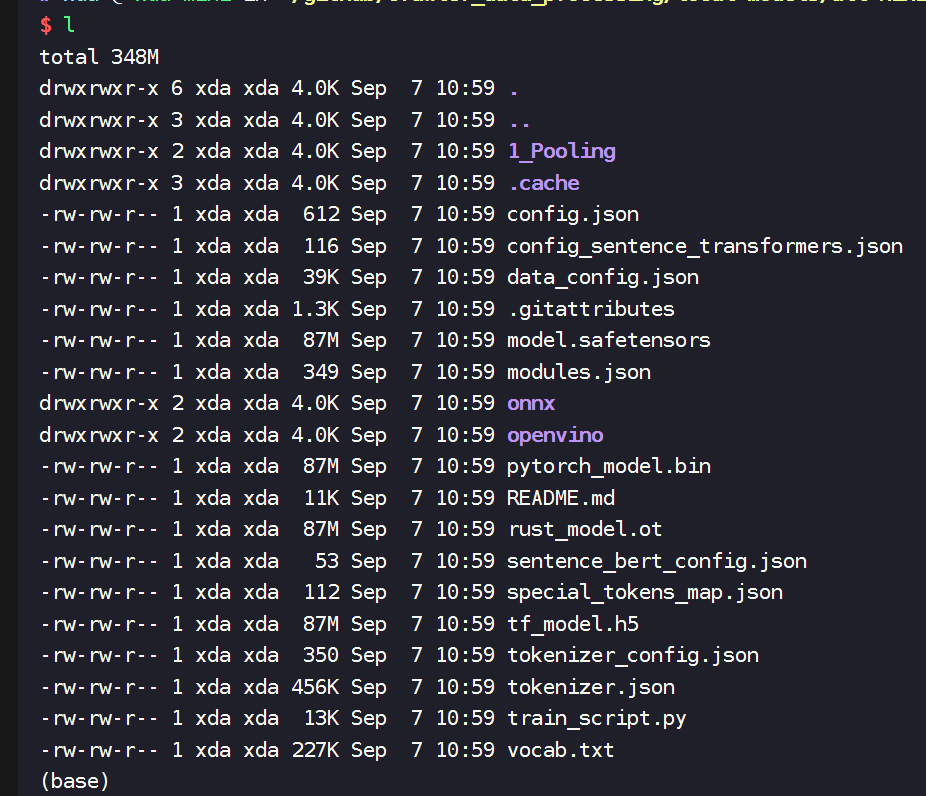

嗖一下380MB的模型就下好了。去我们刚刚定义的下载目录./local-models/all-MiniLM-L6-v2